【大紀元2017年12月11日訊】(大紀元記者張秉開編譯報導)人工智能(AI)的發展速度驚人。現在的人工智能具備了偽造視頻的能力,可以達到人眼無法識別真假的程度,因此引發擔憂。

科技網站Futurism近日報導,世界最大顯卡生產商英偉達(Nvidia,也被稱為「輝達」)現已開發出製造假視頻的人工智能。

它可以將冬季景色變成夏季,將白天街景換成夜間,甚至能將家貓變成獵豹,而且效果極其逼真,令人無法分別真偽。

在兩個人工智能虛擬效果對比視頻之中,本來是覆蓋白雪的街景,經過人工智能轉換後,成為綠蔭蔥蔥的夏季景色,道路兩旁的樓群景色也做了相應的變換,與真實的夏季情況幾乎一樣。

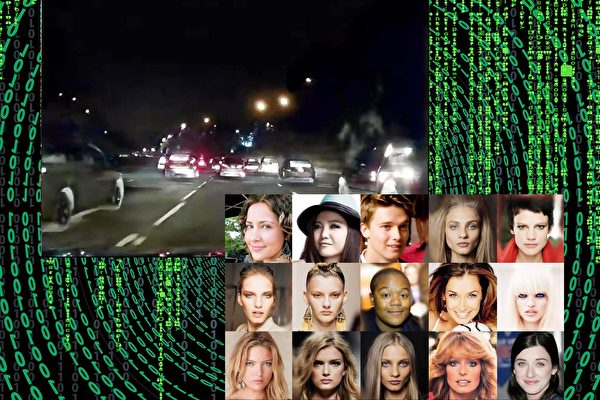

另一個視頻顯示,白天道路上的車流被轉換成夜間的行駛路況,而令人難以懷疑的地方是燈光的細節也被轉換,將白天行車無需常明燈的特徵轉換為有信號燈的情況,而且車燈的亮度各有不同。

Nvidia公司表示,這種人工智能可以不必像以前那樣長時間大量學習,即可達到這種性能。

此前,Nvidia公司曾於10月向大眾展示了其人工智能偽造人物照的性能,效果栩栩如生,完全能做到以假亂真。

Nvidia公司說,這種人工智能技術的名稱為GAN,中文為「生成對抗網絡」(Generative Adversarial Network),意思是具有極強的模仿能力,其目的是欺騙鑑別系統,在被鑑別系統阻攔的情況下隨時調整參數,最終生成鑑別系統無法分辨的結果。

因此,GAP模仿人的臉型,經過20天的「學習」,既可製造出清晰度和細緻程度極為逼真的人物像,又能欺騙人眼的判斷力。

而谷歌的DeepMind人工智能系統能幾乎完好地模擬人的聲音,而製造出各種虛擬的「人話」,而無法被人的耳朵識別真假。

報導指出,雖然工程師們對其成果感到高興,但是人們擔憂的是,在這個網絡時代,本來就有很多假冒的東西,以假亂真的人工智能更讓人困惑:我們是否相信眼前所見的,到底是真是假。

尤其是,那些假新聞製造者,更會肆無忌憚地恣意橫行,因為它們利用這種人工智能騙人的技術會越來越高。

而此前世界電動車品牌特斯拉(Tesla)總裁馬斯克的表達更驚人,他直指人工智能的發展是召喚惡魔,將造成人類被人工智能控制和毀滅的災難。#

責任編輯:葉紫微