【大纪元2023年05月02日讯】(大纪元记者陈霆综合报导)人工智能(AI)先驱辛顿(Geoffrey Hinton)周一(5月1日)证实,他上周离开了谷歌,让他得以自由谈论对这项技术的担忧。

“我常这样安慰自己:如果我不做,其他人也会做”,辛顿接受《纽约时报》专访时说,“但实在很难看出如何防止坏人利用它(AI)作恶。”

《纽约时报》率先报导了辛顿离职的决定(链接)。他对该报说,他有些后悔一生所做的工作。

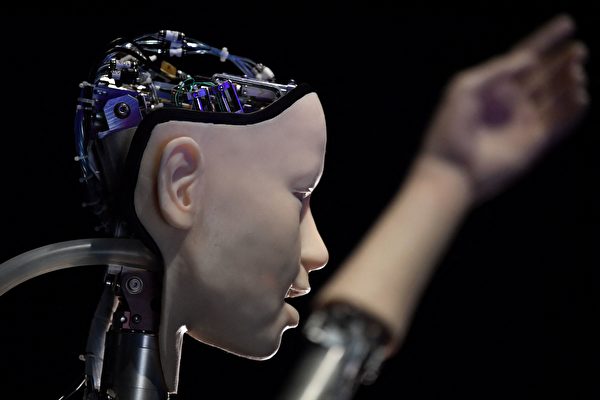

这位现年75岁的学者素有“AI教父”之称,他在神经网络、深度学习方面的开创性工作,塑造了当今AI系统。

辛顿为谷歌服务了10年,协助这家科技巨头开发AI系统,但他最近对这项技术感到忧心。在周一的一条推文中,辛顿说,他离开谷歌是为了能自由谈论AI的风险,并不是想批评谷歌。

“我离开是为了能谈论人工智能的危险,不需考虑这对谷歌的影响”,辛顿在推文中说,“谷歌的行为非常负责任。”

谷歌首席科学家杰夫·迪恩(Jeff Dean)说,辛顿“在AI方面取得了基础性的突破”,并感谢他“对谷歌十年来的贡献”。

“我们仍致力于以负责任的方式对待人工智能”,迪恩一份声明中说,“我们正不断学习,了解新出现的风险,同时也在大胆创新。”

在辛顿决定退出谷歌之际,有越来越多的国会议员、业内人士和技术专家,对AI驱动的新一代聊天机器人提出警告。他们担忧,生成性AI可能成为散播错误信息的工具,并严重冲击就业市场。

目前,OpenAI、微软和谷歌处于这一趋势的最前沿,但IBM、亚马逊、百度和腾讯也在开发类似的技术。

今年3月,许多科技界知名人士签署了一封公开信,呼吁高级AI开发应至少暂停6个月,以制定、实施一套开发与设计先进AI的共享安全协议,否则可能对“社会和全人类构成深刻风险”。(了解更多)

这封信是由马斯克(Elon Musk)支持的非营利组织“生命未来研究所”(Future of Life Institute)所发表,其公布时间就在OpenAI公开了GPT-4之后的两周。在早期测试和公司演示中,GPT-4被用来起草诉讼,通过标准化考试,并通过手绘草图建立一个工作网站。

几天后,拥有40年历史的学术团体“人工智能促进协会”(AAAI)的19位现任、前任领导人也发布了公开信(链接),警告AI的风险。

在接受《纽时》采访时,辛顿表示,他担心AI可能造成许多人失业,并使互联网上充斥着虚假的照片、视频和文字,人们将“无法辨别真假”。

他还指出,AI惊人的进步速度,远超出了他与其他专家的预期。随着科技公司改进他们的AI系统,它们会变得越来越危险。

“过去只有一些人相信,这种东西实际上可变得比人更聪明”,辛顿说,“但大多数人认为这是不可能的。我也曾认为这是不可能的。我认为,那是30到50年甚至更长时间以后的事。很明显,我不再这么认为了。”

许多其他专家表示,这种威胁只是假设性的。但辛顿认为,谷歌、微软以及其他公司之间的竞争,将升级为一场全球竞赛,若没有国际监管,这场竞争不会停止。

在离开谷歌之前,辛顿就曾公开谈论过AI的潜在危害和好处。

在2021年,辛顿曾在孟买印度理工学院的毕业演讲中说,AI将促进医疗保健,但同时也可能有助发展致命的自主武器。

辛顿并不是第一个对AI提出异议的谷歌员工。去年6月,该公司解雇了一名认定谷歌聊天机器人具备人格的工程师。

这位名叫布莱克·勒莫因(Blake Lemoine)工程师声称,代号为LaMDA的AI系统已获得意识,谷歌则称他违反了就业和数据安全政策。◇

责任编辑:叶紫微#